Archives pour Technologies Internet

C’est demain que j’ouvrirai par une courte conférence, un panel Criminalité urbaine et médias sociaux lors du colloque Synergie du Pôle Lavallois d’Enseignement Supérieur en Arts numériques et Économie Créative.

Les médias sociaux ne sont pas étrangers à la criminalité de toutes sortes. Des crimes sont commis sur les plateformes ou grâce à ces plateformes, mais elles peuvent aussi être un outil de gestion des risques, d’enquêtes et même de sensibilisation à la criminalité. J’ai eu la chance lors de la dernière année, de tester deux technologies de monitorage web, utilisées par les forces de l’ordre de différents pays, afin de minimiser les risques d’événements criminels ou à des fins d’investigations subséquentes à des actes criminels. Je testais ces technologies pour un client international oeuvrant dans la gestion des risques pour de très grandes chaînes de commerce de détail ici et ailleurs. J’ai été estomaquée de la pertinence de ces outils et de leurs efficacités. Il s’agit de Babel Street (acheté à plusieurs dizaines de milliers de licences pour le FBI) et DigitalStakeout. Mais il existe de nombreux autres logiciels de ce type. Là où le bât blesse est le coût astronomique des licences de ces outils. Par usagers il en coûte de $30 000 à $200 000 annuellement. Et c’est sans additionner le coût des analystes qui devront passer des heures à comprendre la technologie, puis qui passeront le reste de l’année à monitorer différents sujets et événements. Ces technologies font partie des outils OSINT (Open Source intelligence ou renseignement de sources ouverte). Ce sont donc les informations qui sont libres de droits et disponibles gratuitement, pas les outils.

Aussi, il a été remarqué par certains chercheurs que les médias sociaux , dans certains cas, amplifient la criminalité (comme dans le cas des récentes émeutes en France lors de la mort de Nahel Merzouk). On remarque aussi qu’il y a recrudescence de statuts médias sociaux incluant des armes et liés aux gangs de rues. Je rappellerai aussi que les médias sociaux ont été instrumentalisés afin de servir d’outil de recrutement et de planifications des émeutes du printemps érables et de coordination des émeutiers sur le terrain durant les événements.

Nous discuterons donc de comment les médias sociaux sont à la fois une source possible de croissance de la criminalité tout en étant à la fois des outils permettant de prévenir des crimes ou de trouver des coupables dans un processus d’enquête. Vous trouverez plus bas, le PowerPoint de ma courte conférence.

Article publié le mercredi, 27 septembre 2023 sous les rubriques À titre de conférencière, cybercriminalité, cyberintimidation, cybersécurité, Médias sociaux, Technologies Internet et Terrorisme en ligne.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Babelstreet, Digitalstakeout, Pôle Lavallois d’Enseignement Supérieur en Arts numériques et Économie Créative.

(Source: Visualcapitalist.com https://www.visualcapitalist.com/meet-the-competing-apps-battling-for-twitters-market-share/)

Après le Metaverse de Meta qui devait bouleverser le monde, Meta, la maison mère de Facebook et d’Instagram sort le nouveau lapin de son chapeau, Threads. En fait, il s’agit d’une autre application de microblogage somme toute, identique à Twitter. Elle y est si semblable que l’avocat de Musk a envoyé une mise en demeure à Zuckerberg, l’accusant d’enfreindre la propriété intellectuelle. Rappelons au passage que Facebook a été fondée sur le vol de données photographique à Harvard lors du lancement de son ancêtre Facemash. Rappelons aussi les très nombreux scandales qui ont jonché son histoire. (Dans TheGuardian)

Indeed, Facebook was born, lives and thrives in scandal. There were scandals before this hearing, such as violations of privacy that led to a Federal Trade Commission consent decree in 2012. There were scandals after this hearing, such as Facebook being exposed as facilitating a genocide in Myanmar. In 2019, the US government fined Facebook $5bn for violating its commitment to the government to stop deceiving its users over their ability to control the privacy of their personal information. In 2020, the House antitrust subcommittee revealed documents showing Mark Zuckerberg as explicitly predatory in his business methods, which were supplemented by the Federal Trade Commission complaint filed earlier this year. And yet, we see almost no action of consequence.

Vous pouvez d’ailleurs aussi lire chez BusinessInsider, The 16 biggest scandals Mark Zuckerberg faced over the last decade as he became one of the world’s most powerful people.

Le dernier scandale en liste étant celui de la menace de retirer les médias canadiens de Facebook (et éventuellement d’Instagram et de Threads) lorsque la loi C-18 entrera en fonction.

Mais pour revenir à Threads, il est effarant de constater l’engouement des médias pour ce nouvel arrivé et la joie à peine cachée, qu’il fasse disparaître Twitter. C’est que Twitter serait devenu un repère de complotistes, d’extrême droite, de républicains et d’adorateurs de Donald Trump et dirigé par l’égocentrique Elon Musk qui n’a vraiment pas bonne presse. On dit aussi qu’il ne connaîtrait rien à la technologie et qu’il aurait pratiquement tué Twitter. Il a pourtant développé la société logicielle Zip2, la banque en ligne X.com qui est devenue Paypall. Il a cofondé et co-présidé les débuts d’Open AI en plus de fonder et diriger SpaceX, Starlink, Boring Company, Neuralink et Tesla qui est doté du « logiciel » de conduite autonome le plus développé, au moment d’écrire ces lignes. Mais selon certains, il ne connaîtrait rien à la technologie et serait un très mauvais dirigeant pour Twitter.

C’est donc très ironique de lire les louanges de Threads dans ces mêmes médias qui pleurent le détournement de publicité des médias vers Facebook. Mais il semble que la haine de Musk soit plus forte que le bon sens stratégique. Je rappellerai aussi que c’est ce même engouement médiatique, publicitaire gratuit et corporatif qui a mis au monde Facebook. Tous ont durant des années dit à répétition et gratuitement « venez-nous voir sur notre page Facebook ». Et une fois que Facebook est devenue le béhémoth qu’il est, il a remercié les organisations et les publicitaires qui lui ont fait cette pub planétaire gratuite, en faisant pratiquement disparaître les pages de médias et d’entreprises dans l’accueil des usagers. Le fameux ‘facebook Zero » décrié par l’agence Ogilvy.

A niveau fonctionnel et contrairement à Twitter, nous ne pouvons utiliser et suivre les usagers strictement sur mobile. La version bureau étant dépourvue de pratiquement toutes fonctionnalités, lorsqu’elle est disponible. Au moment d’écrire ces lignes, elle est pratiquement toujours en erreur 429.

Le code de statut de réponse HTTP 429 Too Many Requests indique que l’utilisateur a envoyé trop de requêtes en un temps donné. Un en-tête Retry-After (en-US) peut être inclus dans cette réponse afin d’indiquer le temps à attendre pour effectuer une nouvelle requête.

Par ailleurs, comme le note le pote Charles Nouÿrit en commentaire à un statut de l’autre ami Claude Malaison lors d’une conversation que nous y avions:

Charles Nouÿrit

un fiasco annoncé

Claude Malaison

Charles Nouÿrit Par?

Charles Nouÿrit

Quelle est la valeur ajoutée à Twitter ?

Michelle Blanc

Charles Nouÿrit Meta’s Threads Is Currently A Dystopian Utopia Because Of Its Algorithmic Feed https://www.forbes.com/sites/paultassi/2023/07/10/threads-is-currently-a-dystopian-utopia-because-of-its-algorithmic-feed/ #Analyweb

Charles Nouÿrit

Michelle Blanc c’est exactement ce que je pense, facile d’avoir 100m d’utilisateurs quand tu pars d’une base de 2,35 milliards d’Instagrameurs mais l’ADN et les algos de threads en font un fiasco en devenir

Michelle Blanc

Charles Nouÿrit mon avis aussi. D’ailleurs je disais: Sur Instagram, les gens ne sont pas là pour jaser mais pour voir et se faire voir. De mettre un peu de Facebook version Twitter dans Threads n’en fera pas un Twitter. Les chiffres d’abonnement sont imposants mais j’ai hâte de voir l’engagement disons…

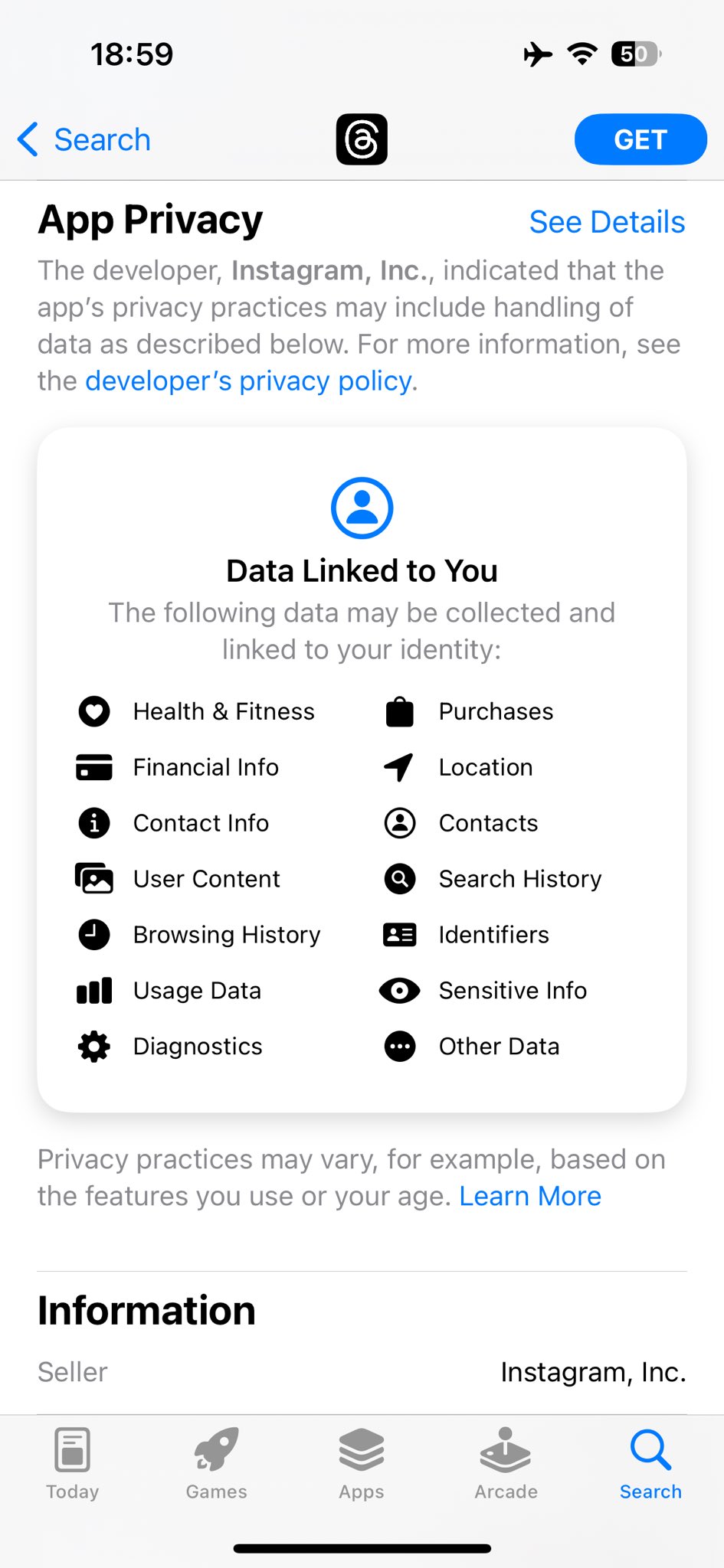

Vous noterez aussi que le fait que la version bureau de Threads, de même que son manque de fonctionnalités nous forçant à utiliser l’interface mobile, permet en outre à Meta de faire le plein d’infos confidentielles. Et ils sont si gourmands d’infos personnelles et confidentielles, qu’ils ont refusé de s’installer dans les pays de l’Union européenne parce que de toute évidence, ils sont loin de respecter la RGPD. On trouvait déjà Tiktok gourmand, mais là, je crois bien que Threads, dépasse toutes les bornes…

Vous pouvez aussi écouter l’entrevue « à chaud » que j’ai donné à CHOI RadioX lors de la sortie de Threads.

Article publié le lundi, 10 juillet 2023 sous les rubriques Applications, Edito sans question, Médias qui sollicitent mes avis, Médias sociaux, Medias et Internet, Mobilité, Technologies Internet et Web mobile.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Données personnelles, Elon Musk, Facebook, Meta, RGPD, Threads, Zuckerberg.

Il m’arrive souvent d’avoir des mandats de diagnostic de site web. J’en ai eu dans plusieurs secteurs d’activité. Récemment, j’ai travaillé pour une organisation du secteur touristique. Comme plusieurs organisations, ils ont donné le mandat de création de leur site web à une agence généraliste. Une agence qui fait de la pub, du placement, des médias sociaux, de la stratégie et du web. Ils semblent être bons dans tout. Ils ont fait un très beau site, mais disons qu’ils ne sont vraiment pas cassé la tête pour faire un site efficace. Personnellement, je préfère travailler avec des développeurs de site plutôt qu’avec des agences. Ils sont souvent plus consciencieux avec le code, les fonctionnalités, les plugiciels et la performance du site. En outre, ils développent sans personnaliser à l’excès et ils choisissent des plugiciels qui ne vont pas restreindre les performances du site. En outre, lorsque vient le temps de faire une mise à jour, le site ne plante pas parce que les plugiciels sont aussi mis à jour.

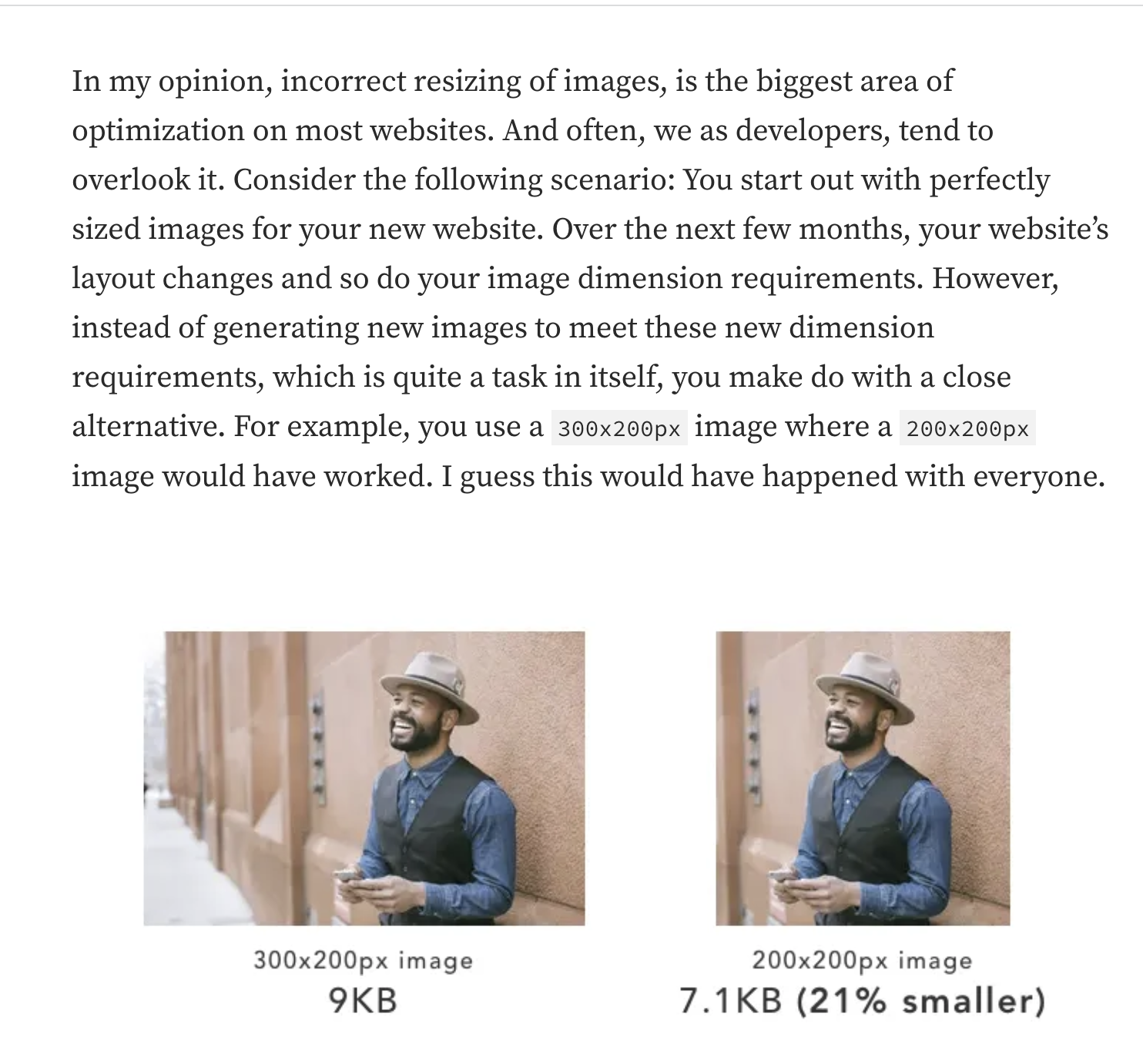

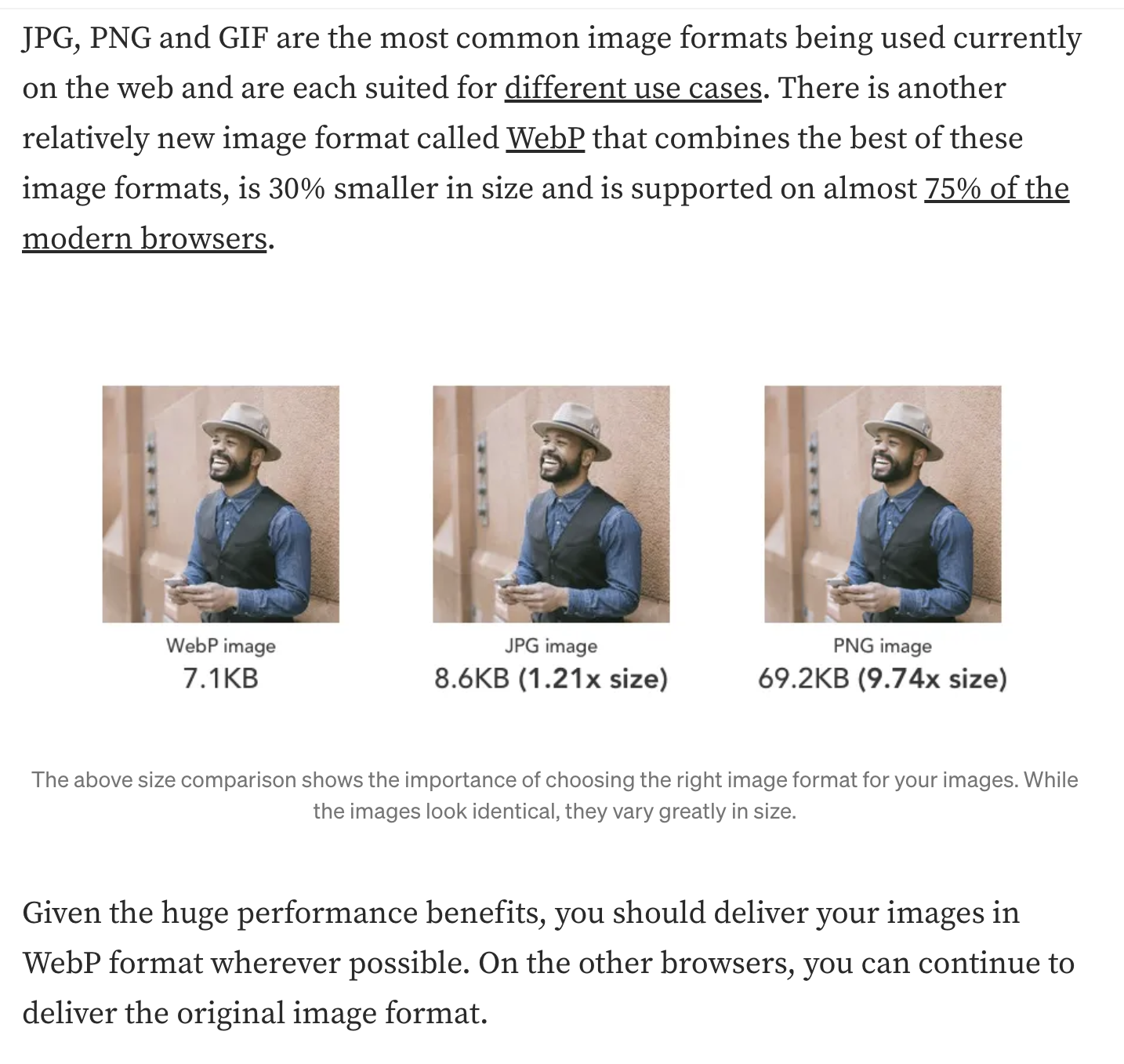

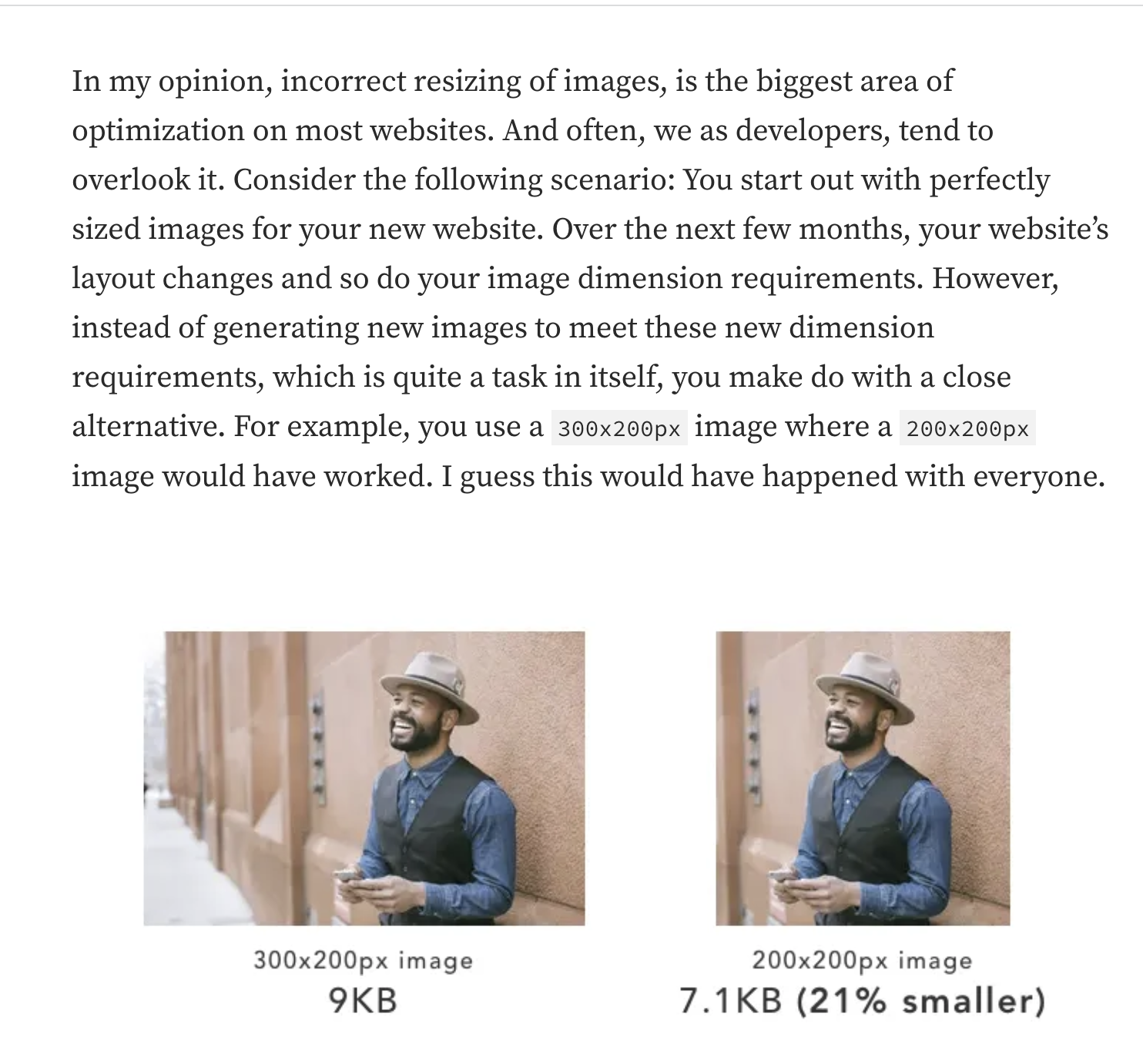

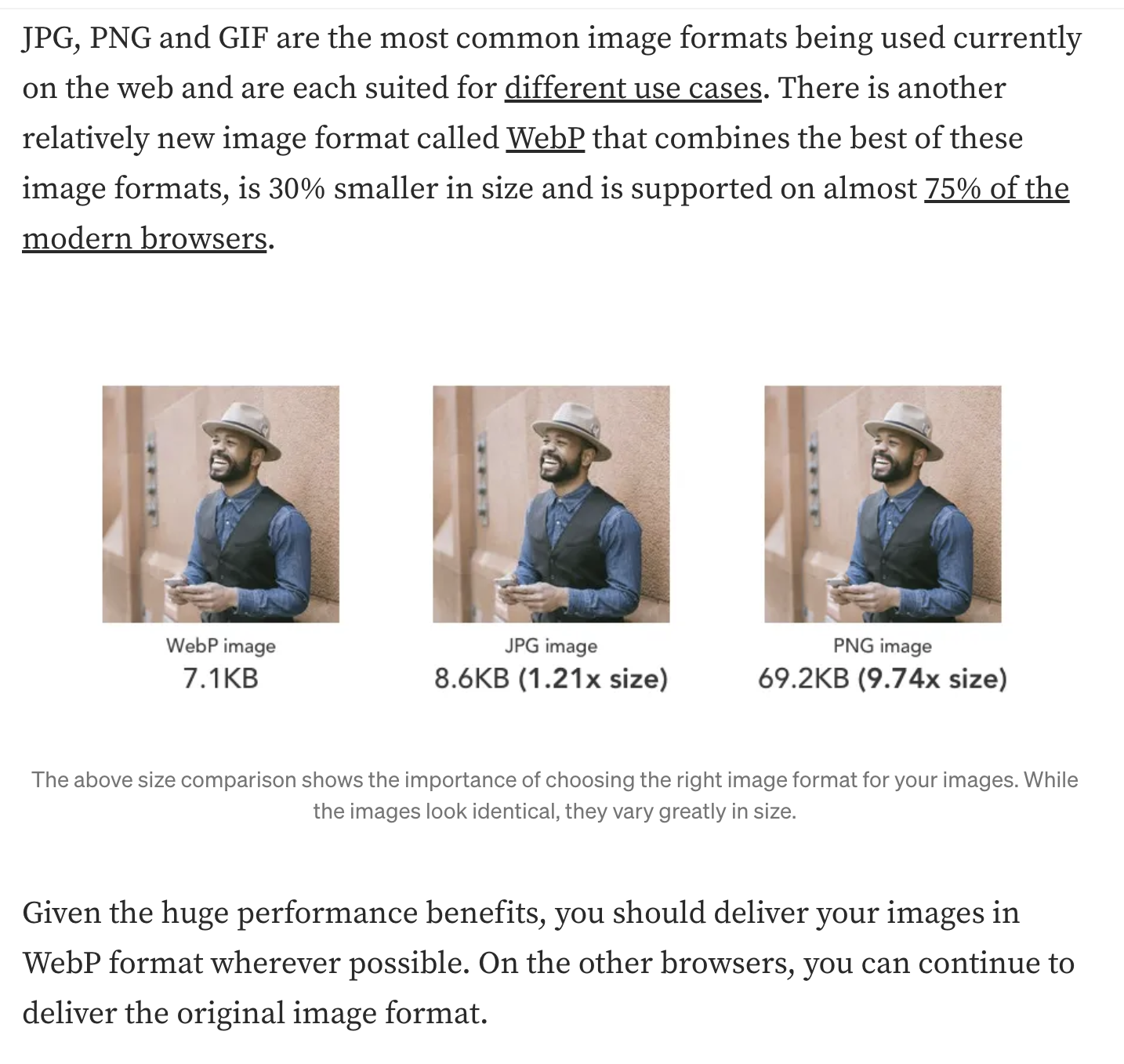

Toujours est-il que l’un des gros problèmes des acteurs touristiques, en plus de choisir les mauvaises agences avec qui ils travaillent, est qu’ils valorisent le visuel. Je les comprends tout à fait. On veut faire rêver le touriste et quoi de plus efficace qu’une photo léchée qui le fera rêver. Or, souvent, ils ont des photos époustouflantes, mais qui sont dans un format et avec une grosseur qui ralentissent énormément le site web ce qui empêche l’internaute de prendre connaissance des contenus. Ils ne réalisent pas (comme vous le voyez dans les photos ci-dessous tirées de https://codeburst.io/5-steps-to-speed-up-your-image-heavy-website-65c874a86966 ) que l’œil ne voit pas vraiment la différence de qualité sur le web.

L’une des solutions est d’encoder vos images avec le standard WebP, plutôt qu’avec le PNG ou le JPEG habituel. Cela réduira déjà la grosseur de l’image de 25% à 34%, ce qui est déjà énorme sur une page web contenant plusieurs images.

Article publié le vendredi, 7 juillet 2023 sous les rubriques Innovation, Marketing 2.0, Marketing Internet, marketing mobile, Moteurs de recherche et référencement de sites Web, Outils et références, stratégie numérique, stratégie web, Stratégies de commerce électronique et Technologies Internet.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : diagnostic de site web, GIF, JPEG, PNG, WebP.

La question des faux comptes et des robots (bots) sur Twitter est loin d’être nouvelle. Elle revient d’ailleurs d’actualité parce que la semaine dernière, dans un rapport officiel aux actionnaires (selon Reuter), Twitter annonçait qu’il y avait moins de 5% de faux comptes sur son engin social. Musk affirma qu’il demanderait à ses experts de sélectionner un échantillon de 100 comptes Twitter pour valider les prétentions de Twitter.

@elonmuskTo find out, my team will do a random sample of 100 followers of @twitter. I invite others to repeat the same process and see what they discover …

Encore une fois, selon plusieurs analyses médiatiques, le méchant Elon Musk serait en train de tenter de foutre le trouble pour faire baisser la valeur de Twitter, pour se dégager de son offre hostile d’achat parce qu’il serait un être capricieux ou une « drama queen ». Le fait est plutôt que le problème des comptes automatisés et autres robots sur Twitter est un problème de longue date. Déjà en 2015, on crucifiait l’ex-maire Denis Coderre, parce que plus de la moitié de ses 219 000 abonnés seraient de faux comptes. (dans LeDevoir).

Le maire de Montréal ne serait pas aussi populaire sur Twitter que le laisse croire son nombre d’adeptes sur le réseau de microblogage. Plus de 63 % de ses 219 000 adeptes sont en vérité de faux comptes, rapporte The Gazette. Le journal a commandé une analyse à une entreprise indépendante, afin d’évaluer la portée réelle de celui dont on vante la notoriété en ligne. Un gonflement artificiel pourrait être rendu possible grâce à des opérations automatisées rémunérées, mais Denis Coderre assure n’avoir jamais acheté de partisans Twitter en ligne.

Nous sommes donc très loin du 5% de faux comptes revendiqués par Twitter.

Pourquoi le pourcentage de faux comptes Twitter est-il important?

Ce pourcentage est fondamental puisque depuis des années, Twitter présente ce même pourcentage aux actionnaires et aux publicitaires de la plate-forme. Si ce pourcentage était un mensonge prouvé par les analyses forensiques qui sont faites présentement dans le processus de « due dilligence » associées à la vente de l’entreprise ou une fois que Musk aura le plein contrôle de la plate-forme, ça prouverait une fraude de grande échelle des dirigeants actuels de Twitter, que ça ferait baisser substantiellement la valeur de Twitter et que ça ouvrirait la porte à une avalanche de poursuite, tant par les actionnaires que par les publicitaires qui auraient été lésés toutes ces années par des chiffres frauduleux. Disons que c’est potentiellement une méchante boîte de crabes.

Un très intéressant billet publié sur Substack traite dans le détail de ce sujet. About those Twitter Bot accounts présente que:

There is an interesting game of chess going on here between Elon and the management of Twitter over the proportion of accounts on Twitter that are “genuine”—that is, real people—as opposed to various kinds of automated accounts or information warfare sock puppets.

Both sides know a lot more than they are letting on, and both are playing a game of chess over it.

On the surface, it matters a lot because Twitter, as a public company, has made statements to its advertisers and investors through the years about the size, growth and makeup of its Twitter account user base, and if it is revealed that they “fudged the numbers”, there will be hell to pay.

Now that a well-heeled buyer is involved with doing due diligence prior to closing a transaction to take Twitter private—it really matters in a legal sense, too.

Is the number of “fake” accounts 5% or less — as Twitter itself claims — or is it closer to 50%?

It’s portrayed (in a Nelsonian Knowledge sort of way, by some) as though it’s some big unsolvable mystery. Maybe it is, to people without technical skill in data analytics.

But to those of us who know this stuff—it’s outrageous that it is even a point of debate. We know they know—and they know that we know they know.

Checkmate will come, I assure you.

Comme pour tous les autres médias sociaux, les algorithmes sont secrets, nous n’avons pas d’informations précises sur le nombre de vrais et de faux abonnés et ce qui est encore pire pour certains autres joueurs du web, dont Facebook et Google, nous ne savons que peu de choses sur le réel taux de « faux clics » et de ce que ces entreprises font réellement pour les enrayer. J’ai écrit une couple de fois ici à propos du chercheur Augustine Fou, qui prétend que 50% des clics publicitaires seraient de faux clics (à mes débuts il y a 20 ans, on parlait de 20%). Mais comme ces monstres ne sont pas sur le point de se faire acheter, donc auditer, nous n’avons réellement aucun outil indépendant pour valider les prétentions qu’ils mettent de l’avant depuis toutes ces années.

Voilà donc une autre des raisons pourquoi l’achat de Twitter par Musk, est l’équivalent d’un tremblement de terre sur la planète des médias sociaux et des GAFA…

Article publié le lundi, 16 mai 2022 sous les rubriques cybercriminalité, Droit et Internet, Médias sociaux, Technologies Internet et Twitter ou le microblogging.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Augustine Fou, bots, Denis Coderre, Elon Musk.

Voici les questions de Jérôme Blanchet-Gravel (essayiste, journaliste et chroniqueur) et mes réponses à propos de Twitter et d’Elon Musk, pour le média Français Causeur.fr.

-Pourquoi autant de personnalités associées au mouvement woke s’indignent autant de l’arrivée de Musk à Twitter ?

Elon Musk a plusieurs fois fait des remarques désobligeantes envers les tenants du wokisme. Étant donné que certains le perçoivent comme étant un libertarien conservateur, ses positions politiques iraient à l’encontre de l’idéologie woke. Par ailleurs, le phénomène du « shadow banning » (via Wikipedia ) aurait affecté principalement les conservateurs (https://www.vice.com/en/article/43paqq/twitter-is-shadow-banning-prominent-republicans-like-the-rnc-chair-and-trump-jrs-spokesman) en épargnant les démocrates et la gauche américaine. Or, Musk a justement fait un twitt contre cette pratique la journée précédant son acquisition de Twitter.

(https://twitter.com/elonmusk/status/1517716718382166016 ).

Le shadow banning (également stealth banning, ghost banning et comment ghosting1), pouvant se traduire par bannissement furtif, est le blocage (en) total ou en partie d’une communauté en ligne d’un utilisateur, ou du contenu qu’il produit, de telle sorte que celui-ci n’en ait pas conscience

-Quels seront les principaux changements opérés par Musk à la barre de Twitter ?

Les deux changements les plus importants qui ont été déjà mentionnés par Musk, sont qu’il rendra l’algorithme de Twitter (qui est présentement secret) Open Source. Cela veut dire que le code informatique qui régit l’automatisation de la modération sera ouvert à tous. Certains critiques jugent que cela ouvrirait grande la porte aux failles de sécurité. Je rappellerai cependant que contrairement à la croyance populaire, le code source ouvert n’est pas plus dangereux et est même possiblement plus sécuritaire qu’un code source propriétaire et fermé. D’ailleurs, la Gendarmerie française, la NSA, la CIA ou le département de la défense américaine valorisent tous le code source ouvert.

Le deuxième changement majeur est que Musk veut s’attaquer en priorité au problème des bots et des fermes de bots (robots qui font des contenus et qui peuvent augmenter la visibilité d’un contenu tierce) qui sont un facteur majeur de pollution des contenus.

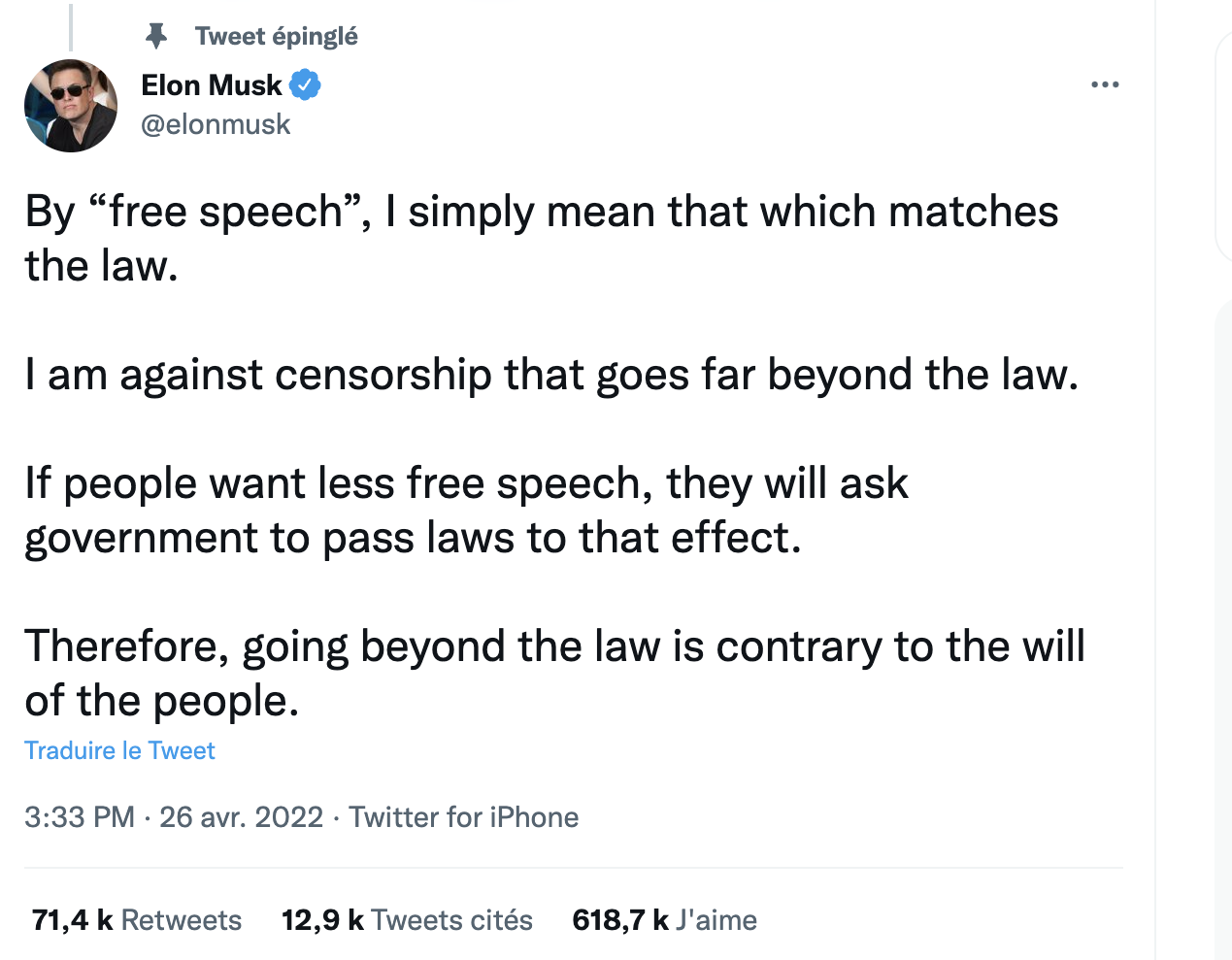

Par ailleurs, Musk répète qu’il respectera les limites légales (judiciaires) des lois sur la liberté d’expression puisque comme il dit, ces lois sont la volonté du peuple et il respecte la volonté du peuple. Par contre, il bannira les pratiques de modération qui vont bien au-delà de ce qui est considéré comme étant légal.

(https://twitter.com/elonmusk/status/1519036983137509376)

-Peut-on vraiment dire qu’Elon Musk a un agenda politique libertarien ?

On peut considérer sa vision large de la liberté d’expression comme étant une position « libertarienne » mais il se définit lui-même comme étant moitié démocrate et moitié conservateur et plutôt centriste.

Politically, Musk has described himself as “half Democrat, half Republican” and “I’m somewhere in the middle, socially liberal and fiscally conservative.”

(source: https://www.youtube.com/watch?v=B1OPxitgvmw)

Rappelons aussi à ses détracteurs qu’il s’est publiquement montré inquiet des changements climatiques, des avancées de l’intelligence artificielle, qu’il a sévèrement critiqué les confinements covid, qu’il appuyait les camionneurs canadiens et mis en doute l’efficacité des tests covid. Il est donc comme plusieurs citoyens, avec des visions complexes qui peuvent à la fois être à la gauche ou à la droite d’un échiquier politique.

-Le marché des réseaux sociaux sera-t-il transformé par cette transaction ?

Twitter est unique dans le « marché des médias sociaux » en ce sens qu’il a introduit la notion de « web en temps direct » lors de la mort de Michael Jackson. C’est aussi le média social de choix pour l’élite politique internationale, les médias, les artistes internationaux et des communicateurs qui créent 80% des contenus du web, hors de Twitter. C’est donc l’un des hauts lieux de l’influence du web, de la politique et des médias. On parle même de « diplomatie Twitter » expression qui n’a jamais encore été utilisée pour d’autres médias sociaux. Je ne suis pas cartomancienne et je ne vois pas l’avenir. Je suis par contre enthousiaste face aux changements que compte mettre en place monsieur Musk pour Twitter. Je noterai aussi en terminant que monsieur Musk est un avide critique et chaud partisan de ce média social et que ce sont là deux caractéristiques très positives pour l’évolution technologique de Twitter.

L’article chez Causeur.fr

Panique chez les wokes: Elon Musk a acheté Twitter https://www.causeur.fr/panique-chez-les-wokes-elon-musk-a-achete-twitter-231642 via @causeur

Article publié le mercredi, 27 avril 2022 sous les rubriques politique et internet, Technologies Internet et Twitter ou le microblogging.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Causeur.fr, Elon Musk, Jérôme Blanchet-Gravel.

Ça fait longtemps qu’on parle de Web 2.0, de la communication omnicanal et bi-directionnelle, de participation citoyenne à la vie municipale et d’une foule d’autres concepts qui permettent d’utiliser le web pour « que tout le monde puisse se parler ». Mais dans la pratique, rares sont ceux qui osent vraiment faire le pas vers plus de transparence, vers l’écoute active des citoyens et des employés et vers cette participation des parties prenantes aux décisions, aux signalements des problèmes et à leurs résolutions ou à l’explication de pourquoi tel problème n’est pas et ne sera peut-être pas réglé. Les organisations, qu’elles soient municipales ou autre, ont souvent aussi une masse impressionnante d’informations qui pourraient être utiles à leurs commettants, mais qui dorment dans les ordinateurs de l’organisation. En outre, les employés sont souvent une source inouïe de connaissances qui ne demande qu’à être partagée.

Quelques exemples :

Les employés du service horticole d’une municipalité peuvent expliquer comment faire du compost, comment entretenir les fleurs ou le potager et ainsi se valoriser auprès des citoyens et limiter les pertes et les résidus qui se retrouveront dans les déchets municipaux.

Le département de la voirie peut expliquer pourquoi une rue qui est de propriété privée, ne peut pas être déneigée parce qu’elle n’appartient pas à la ville, que ça engendrerait des coûts que l’ensemble de la population devrait subir et ce faisant, ça limiterait les questions répétitives aux préposés à l’information.

Le service des incendies peut informer la population des mesures à prendre pour limiter les feux de forêt durant l’été et avertir la population via SMS, courriel ou appel automatisé d’un sinistre qui requiert l’évacuation urgente et ainsi sauver des vies.

Les citoyens peuvent participer aux décisions budgétaires de la ville et ainsi être conscient de comment et à quel poste budgétaire leurs taxes servent réellement.

Nous pouvons imaginer une foule d’autres situations pour lesquelles, une fois qu’ils sont adéquatement informés, les citoyens ou employés, comprendront les décisions et initiatives ce qui facilitera la satisfaction et la vie de tous. D’ailleurs, s’ils participent à la prise de décision, l’adhésion n’en sera que plus forte et l’efficacité sera accrue.

Oui, mais il y aura toujours des critiques!

En effet, il y aura toujours du « chialage », des critiques et des mécontents. Mais il est plus facile de gérer les commentaires négatifs en y répondant positivement chez soi, que de laisser ces commentaires dégénérer et devenir viral sur les médias sociaux. En outre, il arrive que les mécontents soient une source importante des lacunes à corriger et des problèmes qui doivent être résolus.

L’exemple que j’aime donner est celui d’une cliente mécontente de mon client DessinsDrummond qui écrit au président pour lui dire qu’elle ne peut monter un lit king au 2e étage de la maison qu’elle a fait construire avec le plan de DessinsDrummond. Monsieur Carignan lui répondit qu’il la remerciait de son témoignage, qu’il se rendait compte que le Code du bâtiment du Québec ne répondait pas aux besoins des consommateurs et qu’il modifierait tous ses plans de maison pour que dorénavant, un lit king puisse traverser toutes les maisons construites avec ses plans.

Il aurait pu faire un « focus group » avec des gens ressemblant à ses clients et ils auraient discuté de la couleur du plan et de sa présentation, mais aucun n’aurait été capable de l’informer qu’un lit king ne peut être monté au 2e.

Donc pour vous donner une idée d’où s’en va la Ville de La Sarre voici donc le :

Résumé exécutif de la technologie, du contexte, des sites développés, des fonctionnalités et des bénéfices attendus, des futurs sites de la Ville de La Sarre

Resume Executif Sites LaSarre v.10 by MchelleBlanc on Scribd

Vous pourriez aussi aimer lire:

Qu’est-ce que le Web 2.0

Qu’est-ce que le Web 2.0, redux

Le Web 2.0 chez les organisations

Le Web 2.0 dans l’organisation, opportunités et défis

Médiation et règlement des conflits web 2.0

Article publié le mardi, 26 avril 2022 sous les rubriques entreprise 2.0, Innovation, Marketing 2.0, politique et internet, stratégie de contenus, stratégie numérique, stratégie web, Technologies Internet et Web 2.0.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Depuis l’annonce de Facebook qu’il créait Meta et l’annonce que Meta investirait massivement dans le métavers, les nouvelles se sont bousculées. C’est David Fayon qui nous mentionnait dans son récent billet que le mot « métavers » était le mot numérique de 2021. Moi-même, j’ai partagé un statut social révélant mon récent achat de l’Oculus Quest2. J’ai aussi écrit un récent billet sur Les nouveaux, anciens métavers et partagé un statut social sur mes premières impressions d’Oculus :

Après avoir essayé la réalité virtuelle, mon amour dit craindre que les gens ne veuillent plus revenir dans le réel. Au contraire, après y avoir passé une heure ça me fait du bien de descendre dans le garage, de toucher ma corde de bois, de sentir les patates et de les éplucher.

Mais pour revenir au sujet de « l’ébullition des métavers », il vous suffira de jeter un coup d’œil à la série d’articles que je mets en référence plus bas, pour réaliser que les bonzes de la techno que sont Meta, Microsoft et Apple investissent des milliards dans cette aventure. Ils ont chacun leurs avantages concurrentiels. Pour l’instant, Meta (Facebook) a l’avantage des casques de réalité virtuelle pour consommateur à prix compétitif Oculus et son impact auprès de ses milliards d’usagers. Microsoft a l’avantage des logiciels de modélisation 3D, de la plate-forme et des outils 3D qu’utilisent déjà les concepteurs, les entreprises et les industriels et qui fonctionnent avec les casques de réalité virtuelle moyen et haut de gamme (à plusieurs milliers de dollars), sa récente acquisition de Activision (gaming) et sa longue expérience de développement de jeux virtuels et Apple a l’avantage de développer des logiciels et des outils numériques haut de gamme et devrait mettre en marché son premier casque virtuel et de réalité augmentée d’ici la fin de 2022. Elle a aussi la confiance du respect de la vie privée qui est de loin très supérieure à ce qui est projeté par Facebook, de même que les iTune Store et App Store qui pourraient très certainement être à profit pour développer leurs propres plates-formes qui seraient peut-être moins contraignantes que celle de Meta. Même le géant chinois Baidu a annoncé entrer dans la mêlée.

Je dois vous admettre qu’après avoir été l’une des grandes spécialistes francophones de l’univers 3D Second Life (et la nouvelle du retour de son fondateur qui veut revamper sa plate-forme) et ayant observer de première main les innovations fulgurante qui ont été développé sur cette plate-forme il y a 15 ans, je ne peux qu’être enthousiaste. Je rappelle que dans cet univers 3D qui visionnait sur un écran 2D, déjà toutes les annonces de Meta (Facebook) y étaient. Qu’on parle de cours à distance, d’application militaire, de commerce virtuel, de mentorat virtuel, d’applications en psychiatrie, architecture, design, de rassemblement politique, de spectacle virtuel, de tourisme 3D et autres, y était déjà.

Après une accalmie relative d’une dizaine d’années, c’est stimulant d’observer cet engouement financier et technologique nouveau. Il reste à savoir quelle direction ça prendra, qui sera ou seront les joueurs majeurs, quelles plates-formes seront ouvertes et comment nous pourrons ou pas, passer d’une plate-forme ou d’une technologie à l’autre. Les prochains mois et les prochaines années seront palpitants pour le 3D…

D’ailleurs pour comprendre la différence d’approche des métavers de Microsoft et Meta, ce petit montage de Cnet est très intéressant pour comprendre comment Microsoft s’intéresse plus aux entreprises que Méta qui vise surtout le consommateur.

Microsoft Metaverse vs Facebook Metaverse (Watch the reveals)

Revue de presse à propos de l’engouement récent des métavers

MARK IN THE METAVERSE Facebook’s CEO on why the social network is becoming ‘a metaverse company’

Faut-il se laisser tenter par un achat immobilier dans le métavers ?

How The Metaverse Will Reshape E-Commerce Forever

Microsoft Deal Wipes $20 Billion Off Sony’s Market Value in a Day

This group of tech firms just signed up to a safer metaverse

‘Une partie de l’e-commerce a déjà basculé dans le meta-commerce’

Si j’étais candidat, je proposerais… : « Un plan d’investissement de 20 milliards pour le métavers »

Microsoft to acquire Activision Blizzard to bring the joy and community of gaming to everyone, across every device

Will Microsoft’s acquisition of Activision Blizzard finally bring scrutiny on the video game industry?

Microsoft s’installe dans le métavers

3 Reasons Why Apple’s Upcoming VR Headset Could Be the End of Facebook

Chine | Le géant de l’internet Baidu fait ses premiers pas dans le métavers

CEO Born in Soviet Russia Says Metaverse Is Just Like Communist Propaganda

Walmart is quietly preparing to enter the metaverse

CEEK presented H&M metaverse concept store

Second Life founder returns to revamp his original metaverse

This is how Walmart envisions Shopping in the #Metaverse

À quoi ressemblera le métavers de Mark Zuckerberg ? À Facebook, mais en bien pire !

My big fat digital wedding: Indian couple plan country’s ‘first metaverse marriage’

Dans le métavers, le marché immobilier a la cote

The metaverse has a groping problem already

Virtual real estate plot sells for record $2.4 million

Métavers, élu mot numérique 2021 –

Nike investit le métavers en rachetant le fabricant de chaussures virtuelles RTFKT

Le métavers est un échappatoire aux monopoles numériques

Pour faire tourner le métaverse, il faudra changer « l’infrastructure entière de l’Internet »

Meta rachète Within, développeur de l’application VR de fitness Supernatural

Article publié le mercredi, 26 janvier 2022 sous les rubriques Applications, Commerce de détail en ligne, Economie des affaires électroniques, Facebook, Innovation, Marketing des univers virtuels, Metavers, Second Life, stratégie numérique et Technologies Internet.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Baidu, Micrtosoft, Oculus.

L’un de mes clients municipaux me demande d’analyser deux applications (et fonctionnalités) web qu’il aimerait implanter sur son site web. La première est une fonctionnalité québécoise d’alerte multiplateforme en cas de problématique comme un sinistre, feu de forêt, avis d’ébullition, risque de gel et autres. L’autre application en est une de soi-disant intelligence artificielle municipale (en faisant valoir le concept de ville intelligente) permettant de payer ses contraventions, répondre à un sondage, chatbot ou de carte numérique intelligente.

Le problème des données personnelles

Tout d’abord je spécifie que les deux fournisseurs de ces applications/fonctionnalités sont québécois et que leurs clients le sont presque exclusivement aussi. Je ne les nomme pas afin de ne pas compromettre ni ces entreprises ni ces municipalités (et de toute évidence afin de ne pas m’exposer à des poursuites préventives). L’un des deux fournisseurs n’a même pas de politique de vie privée sur son propre site. L’autre, a une fiche de recommandation peu enviable sur le AppStore d’Apple comme quoi, il est plein de bogues. De surcroit, les deux utilisent principalement l’architecture de sous-domaine de leur propre site afin de fournir la fonctionnalité, comme dans l’exemple: VilleXYZ.Fournisseurmédicocre.com . Ainsi, les usagers qui sont des payeurs de taxes de la municipalité sont en fait redirigés sur le site du fourniseurmédiocre.com qui a le contrôle complet de leurs données. À contrario, il existe des équivalents comme par exemple Onesignal qui grâce à une API, peut faire la même chose (et même plus) que la fonctionnalité d’alerte québécoise, tout en restant dans l’environnement de la municipalité. Il en va de même pour l’autre application.

Ce qui est ridicule avec ces cas et me rappelle la folie des CMS il y a 15 ans est que de petites boîtes se présentent comme ayant inventé le bouton à quatre trous dans un contexte d’une « demande en vogue et à la mode », alors que des alternatives open source, gratuites ou pratiquement gratuites et sécuritaires, existent déjà et que des clients québécois les payent sans (semble-t-il) avoir fait de diligence raisonnable et sans avoir évaluer les risques pour les données de leurs citoyens. C’est pitoyable…

Article publié le lundi, 13 décembre 2021 sous les rubriques Big data, Code-source libre, cybersécurité, géolocalisation, Gouvernement électronique, stratégie numérique et Technologies Internet.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

Libelés : Données personnelles, informatique municipale, onesignal.

Ce matin je discutais avec une jeune amie qui est consultante marketing internet. Elle me raconte l’histoire d’une de ses clientes à qui elle a dit que ses investissements Adwords n’avaient pas de bon sang. Elle lui démontra qu’elle continue de payer $20 000/mois pour faire de la pub pour des vêtements de printemps alors que nous sommes maintenant l’automne. La cliente n’a pas apprécié.

Ce n’était pas dans son mandat directement. Elle avait découvert cette incongruité un peu par accident et voulait en faire profiter sa cliente. Le problème avec ça est que souvent les gestionnaires n’aiment pas se faire prendre en défaut. Surtout si c’est eux qui ont pris la décision d’achat. C’est un problème que j’ai souvent confronté dans ma carrière. On engage souvent une consultante comme moi lorsque ça ne va pas bien ou lorsqu’on s’apprête à faire un investissement Web et qu’on veut être certain de ne pas tirer son argent par la fenêtre. Dans ces cas, on veut réellement comprendre, avec des exemples concrets et des preuves irréfutables ou littératures scientifiques à l’appui, pourquoi les rendements ne sont pas là ou comment éviter de faire des erreurs coûteuses avec ses futurs investissements internet. L’écoute est très ouverte et on veut réellement savoir. On paye pour apprendre et comprendre les problèmes. Mais si on est engagé pour faire de la production ou si on veut charmer un client potentiel, la vérité sur les bévues passées n’est pas la stratégie la plus gagnante. Il faut que l’interlocuteur soit prêt à entendre la vérité. Sans ça, c’est souvent un coup d’épée dans l’eau et pire, un recul dans la qualité de la relation.

Un de mes clients me demande un jour ce que je pensais d’un de ses placements Adwords. Il y dépensait $6000/mois ce qui est une somme non négligeable. Après vérification, je lui mentionnais que son fournisseur le positionnait sur des requêtes avec son nom et pour des mots-clés pour lesquels il était déjà naturellement en première position sur les moteurs de recherche. Il me semblait que c’était de l’argent jeté par la fenêtre, ce que je lui démontras. Or, il y avait un aspect politique et de nombreux de ses partenaires insistaient pour une campagne Adwords. De plus, il n’y avait pas de pages interstitielles menant vers une action pouvant être mesurée et traduite en conversion. Bref, on voulait mon avis, mais rien ne pourrait changer. Quelques mois plus tard, il me fit suivre le courriel de l’un de ses partenaires qui venait lui dire exactement la même chose. Le fruit était désormais donc mûr pour cesser cette dépense inutile.

La consultation c’est donc des fois de savoir quand taire une vérité lorsque le client n’est pas prêt à l’entendre, des fois poser des questions pour vérifier l’ouverture d’un client à entendre et comprendre une bévue passée qui continue de coûter cher à l’entreprise et des fois, pouvoir révéler dans le détail comment améliorer certains éléments d’un marketing web ou d’une technologie utilisée parce que c’est spécifiquement le mandat que nous avons à réaliser.

Le moins pire des deux maux

Il arrive aussi que les mauvaises nouvelles d’une analyse, révèlent le malaise de choisir entre deux maux. Dans ma pratique, il m’est arrivé souvent de devoir dire à un client que sa plate-forme web, que son architecture, que son modèle d’affaires ou que son initiative numérique est totalement déficiente et qu’il devrait rebâtir son affaire à partir de zéro. Le client intelligent comprend tout de suite l’enjeu et est placé devant un dilemme. Devrais-je sortir du nouvel argent pour refaire « XYZ » ou puis-je à la place réparer ce que j’ai déjà? Méchant dilemme! Des fois la réponse est limpide et la réponse est « vous devriez refaire votre site web maintenant sinon vous continuerez d’investir dans un site qui inévitablement devra être refait et ça risque de vous coûter encore plus cher ». Mais d’autres fois, il est possible de corriger les erreurs et de continuer pour un moment avec l’environnement existant. Le client choisi le moins pire des deux maux. Dépenser un gros montant pour se mettre à jour immédiatement ou dépenser beaucoup moins pour tenter de faire fonctionner ce qui de toute évidence devra être remplacé. Dans tous les cas, le consultant doit comprendre que la solution facile n’est des fois pas atteignable et que malgré sa bonne volonté, le client sera placé devant des choix difficiles et qu’il est celui qui vivra avec les conséquences. Imaginez alors de mettre un client devant ce genre de dilemme s’il ne vous a rien demandé, s’il ne s’y attend pas et s’il a pris les décisions menant vers ce dilemme? C’est pourquoi il est souvent préférable d’avoir un mandat clair pour dévoiler ce genre de chose, plutôt que de vouloir aider un prospect ou une relation d’affaires, par altruisme…

Article publié le lundi, 8 novembre 2021 sous les rubriques Marketing Internet, Moteurs de recherche et référencement de sites Web, stratégie web, Stratégies de commerce électronique et Technologies Internet.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.

J’ai l’habitude de cuisiner « au pif » comme le faisait ma mère. Et sauf pour les desserts, les recettes peuvent et doivent être adaptées au goût de la cuisinière et des convives. D’ailleurs, quelqu’un me demandait dernièrement sur Facebook combien de temps je faisais cuire mes poulets. Ma réponse fut « ça dépend ». En effet, la grosseur des poulets y est pour quelque chose de même que le mode de cuisson et la chaleur du four. Il n’y a donc pas de réponse toute faite si ce n’est qu’un poulet cuit doit atteindre 180F.

Je vous parle de ça parce que c’est un peu la même chose avec le Web. Quelle est la recette magique pour une saine présence web? Ça dépend. Ça dépend d’une foule de facteurs et comme pour les desserts, certaines proportions sont fondamentales pour arriver à un résultat sain. Vous pourrez toujours user de créativité pour décorer votre gâteau, mais la base de celui-ci devra contenir des éléments avec des proportions qui seront pratiquement toujours identiques. Par ailleurs, pour la cuisine, nous avons de grandes écoles hôtelières, des confréries, des compétions, des associations professionnelles et ultimement des clients « goûteurs » qui trouveront les mets appétissants ou pas. Pas besoin d’avoir eu des cours très poussés pour aimer ou pas. Nos sens prennent la relève et le verdict est instantané. Pour le web c’est plus délicat. Bien certainement on trouvera un site web beau (ou pas) et on aura une facilité à naviguer et à trouver les infos que l’on cherche (ou pas). Mais c’est là que le bât blesse. Bien des propriétaires d’entreprises ou de gestionnaires ont cette capacité à évaluer superficiellement un site web et une présence sociale. Ils n’ont pas les outils pour en évaluer la performance, l’efficacité et le retour sur l’investissement. Mais comme ça a l’aire facile de prime abord, ils donnent des contrats et attendent les résultats. Ils vont souvent s’attarder « au beau » et « aux concepts publicitaires et graphiques »qu’on leur présentera. Pour le reste, ils feront confiance au fournisseur qu’ils auront choisi.

Je vous parle de ça à cause de deux récents mandats que j’ai eus. Le premier en est un de témoin expert pour une cause civile de plusieurs centaines de milliers de dollars. Je n’entrerai pas dans les détails techniques pour préserver la confidentialité de mon dossier, mais disons qu’un acheteur n’étant pas content de la vitesse de téléchargement du site transactionnel qu’il a commandé, a décidé de ne pas payer le fournisseur, d’où la poursuite de celui-ci. Je dois donc analyser les aspects techniques du site et témoigner en cour de mes observations pour éclairer la cour au niveau technique. Cependant, si on m’avait contacté au début du mandat, j’aurais sans doute rédigé l’appel d’offres et participé à la sélection du fournisseur afin d’éviter ce triste événement.

Le deuxième mandat est celui de l’un de mes anciens clients à qui j’avais transféré mes connaissances quant à ses présences web. Une dizaine d’années plus tard il me téléphone pour que je lui fasse une analyse de mots-clés. Je regarde rapidement son site web et immédiatement je m’aperçois de plusieurs lacunes majeures dans celui-ci. Je lui dis donc que je peux certainement faire l’analyse de mots-clés qu’il me demande, sauf que si c’est pour mettre dans son site web actuel, ce serait de l’argent tiré par la fenêtre. Je lui dis aussi que j’étais surprise de la technologie qu’il avait choisie plutôt que celle que je lui avais recommandée à l’époque. Il me demande donc plutôt de lui faire une analyse technique de son site. La semaine dernière je lui ai présenté le résultat de mon audit. Il est catastrophique. Son site est d’une très grande beauté. Son fournisseur travaille principalement dans l’événementiel et dans ce secteur le tape à l’œil vaut son pesant d’or. Dans le secteur de l’ingénierie civile, c’est sans doute aussi important. Cependant, à moins de continuellement dépenser en publicité en ligne, son site est pratiquement invisible aux moteurs de recherche. Au bout d’un moment, ça fait dispendieux « de la présence web ». Il me dit avoir pourtant dépensé dans les 6 chiffres pour cette présence médiocre « d’une grande beauté ». C’est un superbe gâteau de mariage, mais sans gâteau à l’intérieur.

Lorsque des clients viennent me voir en demandant un beau site web, je leur réponds : Avez-vous déjà visité Amazon? Trouvez-vous ça beau? Avez-vous visité Harvard Business Review? Est-ce sexy? Voulez-vous faire du cash ou trouver que votre site est beau?

Pas besoin d’avoir fait les grandes écoles pour être un bon cuisinier et le client saura d’office si le plat est bon ou pas et s’il est bien présenté ou pas. Avec le web, c’est pas mal plus difficile. Zuckerberg n’a jamais fini son bac et il est pourtant maintenant l’un des hommes les plus riches de la planète. Pareil pour Bill Gates. N’empêche que ce sont des cas d’exception. Ça prend 5 minutes pour faire une page Facebook ou pour ouvrir un compte LinkedIn, Instagram ou Twitter. Pour avoir des résultats, c’est un peu plus compliqué et pas mal plus long. Ce n’est pas parce qu’un étudiant a fait un cours de programmation HTLM au CEGEP et qu’il se présente comme expert du web qu’il en est un. Ce n’est pas parce que quelqu’un a été gestionnaire de communauté pour une émission de télé qui s’adonne à avoir levé comme jamais auparavant que cette personne connaît les médias sociaux et qu’elle en est une experte.

C’est un peu ça le problème du web et des médias sociaux. Tout le monde pense connaître ça ou dit être expert. Ce sera vrai jusqu’à ce que les résultats arrivent ou pas. Lorsqu’ils n’arriveront pas, je serai là pour fournir les réponses. C’est seulement triste qu’on me téléphone après plutôt qu’avant. Je suis certainement plus dispendieuse que bien de mes « compétiteurs » sauf qu’à la longue, ça risque d’être pas mal moins cher…

L’avis (indépendant) stratégique et technique web et médias sociaux, ça coûte moins cher avant, qu’après…

Article publié le jeudi, 28 octobre 2021 sous les rubriques Blogue, Blogues d'affaires, Facebook, Marketing de contenu, marketing mobile, Médias sociaux, médias sociaux et relations de travail, Mobilité, Moteurs de recherche et référencement de sites Web, Stratégie d'affaires, stratégie de contenus, stratégie numérique, stratégie web, Stratégies de commerce électronique et Technologies Internet.

Vous pouvez suivre les commentaires sur cet article via ce fil RSS.

Vous pouvez laisser un commentaire ci-dessous ou un rétrolien à partir de votre site.